- Gemma 4 es una familia de modelos abiertos con licencia Apache 2.0, pensada para ejecutarse en local desde móviles hasta servidores.

- Incluye cuatro tamaños (E2B, E4B, 26B MoE y 31B denso) con capacidades multimodales, razonamiento avanzado y ventanas de contexto de hasta 256K tokens.

- Los modelos pequeños pueden correr en smartphones Android vía Google AI Edge Gallery, ofreciendo chat, visión y audio sin conexión ni envío de datos a la nube.

- Su enfoque en agentes autónomos, integración con Google Cloud y ecosistemas como Hugging Face o Ollama la sitúan como pieza clave para la soberanía digital en Europa.

La llegada de Gemma 4 marca un punto de inflexión en la estrategia de Google para la inteligencia artificial abierta y su apuesta por la IA móvil: una familia de modelos capaz de funcionar tanto en la nube como directamente en móviles, portátiles y servidores propios, sin necesidad de conexión. Frente al dominio de los grandes modelos cerrados, esta propuesta busca combinar eficiencia, control sobre los datos y un rendimiento que, sobre el papel, rivaliza con sistemas mucho más pesados.

La nueva generación se apoya en la misma base tecnológica que Gemini 3, pero con un enfoque abiertamente orientado al open source y al uso comercial. Con licencia Apache 2.0 y pesos disponibles para descarga, Gemma 4 pretende situarse como una alternativa seria en Europa y España para empresas, administraciones y usuarios que quieren aprovechar la IA avanzada sin depender por completo de infraestructuras propietarias en la nube.

Una familia de modelos abierta, ligera y escalable

La familia Gemma 4 se compone de cuatro variantes principales: Effective 2B (E2B), Effective 4B (E4B), 26B Mixture of Experts (MoE) y 31B denso. Todas comparten una misma idea de fondo: maximizar la “inteligencia por parámetro”, es decir, sacar el máximo rendimiento posible con un número relativamente reducido de parámetros activos.

El modelo Gemma 4 31B denso se ha colocado ya en el podio de los modelos abiertos del Arena AI text leaderboard, superando a alternativas que le multiplican por veinte en tamaño. Por su parte, el 26B MoE aprovecha una arquitectura de mezcla de expertos que activa solo unos 3.800 millones de parámetros en inferencia, acelerando la generación de tokens por segundo sin disparar el consumo de recursos.

En la parte baja de la gama, los modelos E2B y E4B se han dimensionado específicamente para funcionar en dispositivos modestos: smartphones Android, placas IoT, portátiles de gama media o incluso placas tipo Raspberry Pi. El objetivo es claro: que la IA avanzada no se limite a centros de datos o estaciones de trabajo de alto coste, sino que pueda ejecutarse “a pie de dispositivo”.

Desde el punto de vista empresarial, esta dualidad entre modelos compactos y variantes más grandes permite elegir entre velocidad de ejecución o profundidad de análisis según el caso de uso: asistentes de codificación local, análisis documental complejo, flujos de trabajo agénticos o automatización empresarial.

Multimodalidad avanzada: texto, imagen, vídeo y audio en local

Uno de los grandes saltos de Gemma 4 está en la multimodalidad extendida en toda la familia de modelos. Todos pueden procesar texto e imágenes con flexibilidad en resolución y relación de aspecto, lo que permite desde descripciones detalladas de fotografías hasta lectura de documentos escaneados o análisis de escenas complejas.

Las variantes E2B y E4B van un paso más allá al incorporar soporte nativo de audio y vídeo en dispositivos de borde. Eso se traduce en transcripción y traducción de voz en tiempo real, así como interpretación de secuencias de vídeo en local, sin necesidad de enviar datos a la nube. Para usos cotidianos, es posible emplear Gemma 4 como traductor de bolsillo, herramienta de notas de voz o sistema de subtitulado en local.

En los modelos más grandes, esta multimodalidad se combina con ventanas de contexto que llegan hasta los 256.000 tokens, suficientes para trabajar con repositorios de código extensos, contratos legales voluminosos o grandes colecciones de documentos en una sola consulta. Las versiones destinadas a móviles y edge computing se quedan en 128K tokens, una cifra aún muy por encima de lo habitual en modelos pensados para ejecutarse en el dispositivo.

El soporte para más de 140 idiomas de forma nativa sitúa a Gemma 4 en una posición interesante para el mercado europeo, donde la diversidad lingüística es un requisito práctico para cualquier despliegue serio de IA: desde grandes idiomas como español, francés o alemán hasta lenguas menos mayoritarias.

Gemma 4 en tu móvil: IA local sin depender de la nube

Donde más ruido ha generado Gemma 4 estos días es en su desembarco en el entorno móvil, especialmente en Android, como muestran proyectos como Android Bench. Google ha puesto el foco en que los modelos pequeños puedan funcionar de forma completamente local en un smartphone actual, sin necesidad de cobertura ni WiFi.

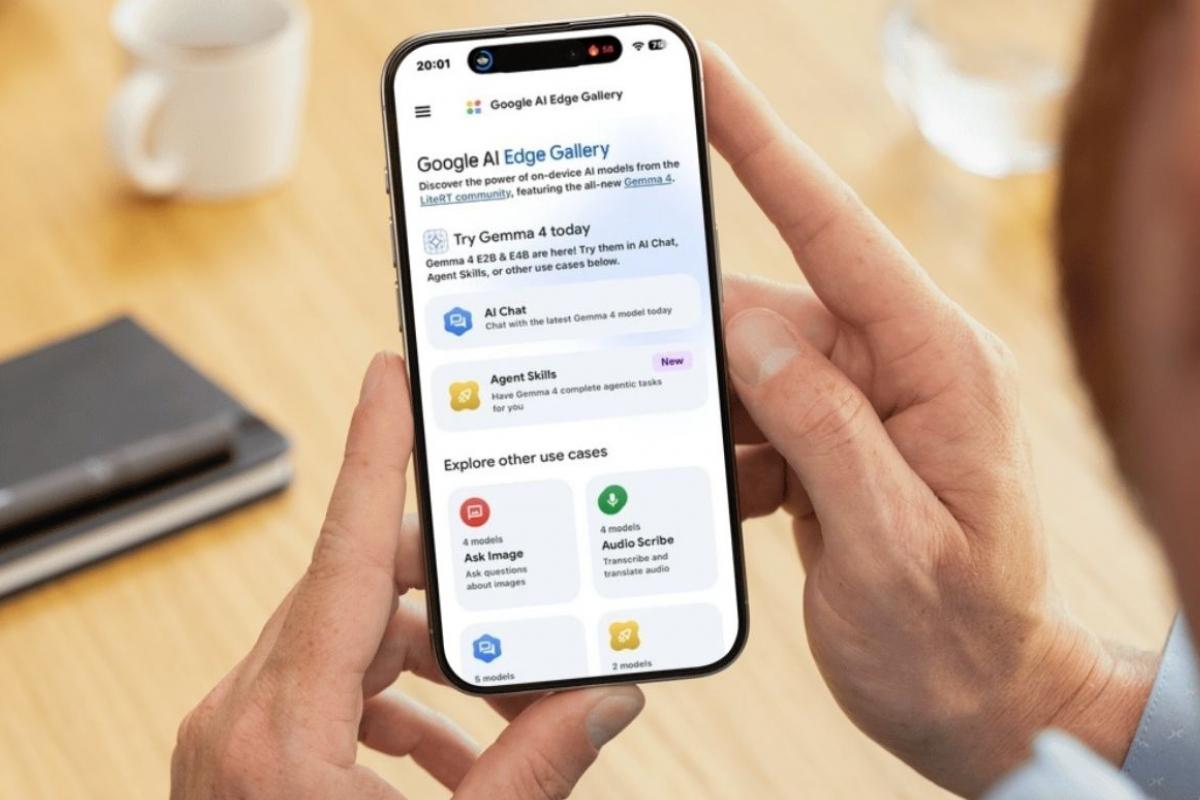

Para conseguirlo, la compañía se apoya en Google AI Edge Gallery, una aplicación experimental y de código abierto diseñada para gestionar y ejecutar modelos de IA en el propio dispositivo. Desde esta app, el usuario puede descargar distintas variantes de Gemma 4 (E2B, E4B, 26B A4B y 31B), probar su rendimiento y elegir la que mejor se adapte a la potencia de su móvil.

Una vez instalada la combinación de modelo y aplicación, Gemma 4 puede actuar como chatbot local, responder preguntas sobre imágenes de la galería, analizar documentos almacenados en el teléfono o transcribir y traducir audio grabado con el micrófono. En dispositivos con permisos de cámara, incluso es posible aprovechar funciones de visión en tiempo real.

Las ventajas son evidentes: al no depender de servidores remotos, desaparece prácticamente la latencia típica de los chatbots conectados, y la privacidad mejora de manera notable, ya que los datos no abandonan el dispositivo. Eso sí, el modelo no puede buscar información en internet cuando está completamente desconectado, por lo que no es un sustituto total de IAs en la nube, sino un complemento muy útil en escenarios sin cobertura o con requisitos de confidencialidad estrictos.

Google AI Edge Gallery: un laboratorio de IA en el bolsillo

La aplicación Google AI Edge Gallery se ha convertido en la puerta de entrada más directa para probar Gemma 4 on-device tanto en Android como, en versión adaptada, en iOS. No se trata de un simple chat, sino de un escaparate de posibles usos de la IA local.

En el apartado AI Chat, la app permite conversar con el modelo como con cualquier asistente, pero sabiendo que todo se ejecuta en el propio teléfono. En Ask Image, el usuario puede subir fotos y obtener descripciones o contexto. La sección Audio Scribe habilita la transcripción y traducción de audio de manera local, una función especialmente interesante para periodistas, estudiantes o profesionales que manejan información sensible.

Otros bloques como Agent Skills, Prompt Lab, Tiny Garden o Mobile Actions sirven para mostrar hasta dónde pueden llegar los modelos locales: desde pequeños juegos controlados por lenguaje natural hasta acciones automatizadas en el dispositivo o pruebas avanzadas de prompts. Todo ello sin necesidad de iniciar sesión con una cuenta de Google ni de mantener una conexión permanente a internet.

La propia aplicación integra un sistema sencillo para descargar y gestionar modelos en función del hardware del usuario. Es posible optar por variantes más ligeras para priorizar fluidez y consumo reducido, o apostar por versiones más grandes si el dispositivo lo permite. Esta flexibilidad, unida a la naturaleza open-weight de Gemma 4, abre un escenario donde cada teléfono se convierte en un pequeño laboratorio de IA.

Razonamiento profundo, agentes autónomos y capacidades de código

Más allá de la ejecución local, Gemma 4 destaca por su enfoque en razonamiento paso a paso y flujos de trabajo agénticos. Google ha incorporado modos de pensamiento configurables que permiten al modelo “pensar en voz baja” antes de responder, descomponiendo problemas complejos y revisando su propio razonamiento.

En pruebas exigentes de matemáticas y programación competitiva, los modelos grandes de Gemma 4 han mostrado saltos muy significativos respecto a la generación anterior, con mejoras de precisión que los sitúan en niveles de programador experimentado. Esta capacidad se traduce en mejores resultados al generar y revisar código, diagnosticar errores o diseñar pipelines lógicos.

Todos los modelos de la familia ofrecen soporte nativo para llamadas a funciones, salida estructurada en JSON e instrucciones de sistema. En la práctica, esto permite construir agentes capaces de decidir qué herramientas externas necesitan usar (APIs, bases de datos, servicios internos) y ejecutar acciones concretas de forma autónoma dentro de un entorno controlado.

Para facilitar el desarrollo de estos agentes, Google proporciona un Agent Development Kit (ADK) modular, pensado para orquestar flujos complejos sin perder de vista la seguridad de los datos. Esta combinación de razonamiento profundo y capacidad de actuar abre puertas a asistentes empresariales más fiables, automatización de soporte técnico o sistemas de atención al cliente que no solo contestan, sino que también resuelven tareas.

Integración en Google Cloud y soberanía digital en Europa

En el plano corporativo, Gemma 4 se integra de forma directa en el ecosistema Google Cloud a través de Vertex AI y Google Kubernetes Engine (GKE). Las organizaciones pueden desplegar los modelos como servicios gestionados, ajustar recursos de cómputo bajo demanda y escalar cargas de trabajo de inferencia según las necesidades del negocio.

Para sectores regulados, uno de los puntos clave es la disponibilidad de Gemma 4 en entornos de Nube Soberana, incluyendo despliegues air-gapped o en premisas. Esto encaja con las crecientes exigencias europeas en materia de residencia de datos y cumplimiento normativo, permitiendo que administraciones públicas y empresas críticas mantengan el control total sobre dónde se procesan sus datos y la capacidad de competir frente a la ARM en centros de datos.

La eficiencia de los modelos grandes se ha ajustado para que los pesos bfloat16 de las variantes de 26B y 31B puedan ejecutarse en una sola GPU NVIDIA H100 de 80 GB, reduciendo la barrera de entrada para compañías medianas que quieren experimentar con IA de alto nivel sin montar infraestructuras masivas.

Además, Gemma 4 se beneficia de optimizaciones específicas en hardware de NVIDIA, AMD, Qualcomm y MediaTek, cubriendo desde servidores y estaciones de trabajo hasta dispositivos móviles, incluso soluciones como el PC con IA que cabe en un teclado. La posibilidad de ejecutar los modelos en Cloud Run con GPUs NVIDIA RTX PRO 6000 (Blackwell) en modalidad serverless ofrece un modelo de pago por uso que facilita pruebas intensivas sin inversiones iniciales desmesuradas.

Licencia Apache 2.0, ecosistema abierto y variantes comunitarias

Uno de los movimientos más comentados ha sido la adopción plena de la licencia Apache 2.0 para toda la familia Gemma 4. A diferencia de las primeras versiones de Gemma, que incluían cláusulas más restrictivas, esta iteración se puede usar, modificar y comercializar sin apenas limitaciones, siempre que se respeten los términos estándar de la licencia.

En la práctica, esto coloca a Gemma 4 en el mismo terreno que otras propuestas abiertas como Llama de Meta, pero con un énfasis particular en eficiencia y despliegue local. Google ha publicado los pesos del modelo, aunque no el pipeline completo de entrenamiento ni el conjunto de datos, por lo que técnicamente se encuadra en la categoría de modelos “open-weight”.

La apuesta abierta está pensada para estimular la creación de variantes regionales y verticales, como ya se ha visto con versiones anteriores que dieron lugar a modelos adaptados a idiomas y contextos específicos (por ejemplo, proyectos académicos en Europa del Este o herramientas médicas desarrolladas en universidades estadounidenses).

Desde el primer día, Gemma 4 se ha integrado en plataformas como Hugging Face, Kaggle, Ollama, LM Studio o vLLM, con soporte para Mac, Windows y Linux. Esta disponibilidad inmediata facilita que desarrolladores independientes, centros de investigación y startups en España y el resto de Europa puedan experimentar, afinar y desplegar sus propias variantes sin tener que reinventar la rueda.

Impacto para usuarios, empresas y el ecosistema europeo

Para el usuario medio, la propuesta de Gemma 4 se resume en tres ejes: más privacidad, menor dependencia de la conexión y mayor versatilidad. Contar con un modelo capaz en el móvil, que puede funcionar en modo avión y que no envía datos personales a la nube, resulta especialmente atractivo en un contexto de creciente sensibilidad sobre la protección de datos.

En el tejido empresarial, especialmente en pymes tecnológicas y startups europeas, Gemma 4 abre la puerta a reducir costes de operación frente a soluciones puramente cloud. Ejecutar modelos en servidores propios o en infraestructuras locales bien dimensionadas puede suponer un ahorro notable a medio plazo, al tiempo que se mantiene el control sobre la información estratégica.

También entra en juego la competencia con otros modelos abiertos como Qwen o Llama, que han ganado mucha tracción en los últimos meses. Gemma 4 busca diferenciarse por su rendimiento en razonamiento matemático, su integración directa con audio en los modelos compactos y la fuerte apuesta de Google por la ejecución en el borde y la soberanía digital.

Para los departamentos de IT y responsables de innovación, la decisión no es trivial: apostar por modelos cerrados, más sencillos de usar pero menos controlables, o por modelos abiertos como Gemma 4, que exigen más trabajo de integración pero ofrecen un margen mayor para optimizar costes y personalizar soluciones.

En conjunto, Gemma 4 consolida una tendencia que llevaba tiempo gestándose: la inteligencia artificial de alto nivel deja de ser exclusiva de los grandes centros de datos y empieza a instalarse tanto en el bolsillo de los usuarios como en los servidores de empresas que quieren independencia tecnológica. Para España y el resto de Europa, donde la soberanía digital y la regulación de datos son temas cada vez más centrales, esta nueva generación de modelos abiertos puede convertirse en una pieza clave a la hora de diseñar la próxima ola de servicios y productos basados en IA.