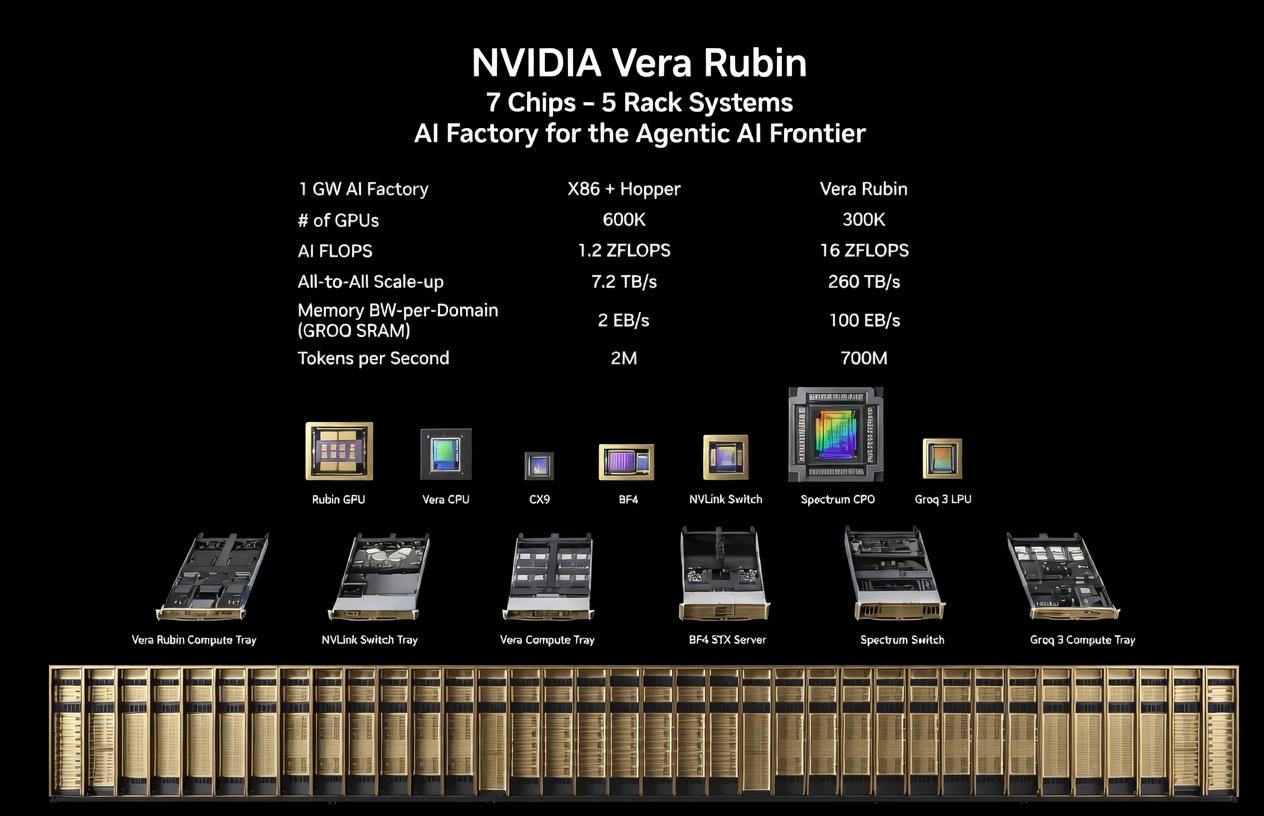

- Vera Rubin integra siete chips y cinco racks para funcionar como una única supercomputadora de IA a escala de POD.

- El rack NVL72 combina 72 GPU Rubin y 36 CPU Vera, con hasta 10 veces más rendimiento de inferencia por vatio y 1/10 del coste por token frente a Blackwell.

- Racks específicos de CPU Vera, Groq 3 LPX y BlueField-4 STX permiten escalar la IA agéntica, el almacenamiento de contexto y la eficiencia energética en centros de datos.

- La plataforma llegará en la segunda mitad del año a través de AWS, Azure, Google Cloud, Oracle y grandes fabricantes como Cisco, Dell, HPE o Lenovo.

La irrupción de NVIDIA Vera Rubin como nueva plataforma de infraestructura de inteligencia artificial marca un cambio de enfoque en el sector: el centro de datos deja de verse como un conjunto de servidores aislados y pasa a entenderse como una única supercomputadora diseñada específicamente para fábricas de IA. El objetivo ya no es solo entrenar modelos de gran tamaño, sino sostener sistemas de agentes capaces de razonar y actuar de forma autónoma con latencias muy bajas.

Anunciada en el GTC 2026, la propuesta de NVIDIA combina cómputo, red, almacenamiento y gestión energética en una arquitectura integrada. La compañía presenta siete chips y cinco tipos de racks que pueden desplegarse a escala de POD para que múltiples bastidores funcionen como un único sistema coherente. Para las empresas europeas y españolas, esto significa pasar de comprar hardware suelto a plantear auténticas factorías de IA orientadas a agentes.

Una plataforma de siete chips para fábricas de IA

En lugar de centrarse en un único procesador estrella, NVIDIA articula Vera Rubin como una plataforma completa de siete componentes que se han diseñado de forma conjunta para cubrir todas las fases del ciclo de vida de la IA. La lista incluye la CPU NVIDIA Vera, la GPU NVIDIA Rubin, el conmutador NVLink 6, la SuperNIC ConnectX-9, la DPU BlueField-4, el switch Ethernet Spectrum-6 y la LPU NVIDIA Groq 3 orientada a inferencia.

Según la compañía, estos siete chips están pensados para operar como una supercomputadora de IA a escala de rack, organizada en cinco tipos de bastidor: el rack de cómputo NVL72, el rack de CPU Vera, el rack Groq 3 LPX para inferencia de baja latencia, el rack de almacenamiento BlueField-4 STX y el rack de red Spectrum-6 SPX. Cada uno asume un rol específico dentro de la fábrica de IA, desde el entrenamiento masivo hasta la inferencia agéntica en tiempo real.

La empresa insiste en que el salto generacional no viene solo de la potencia de cada chip, sino del codiseño entre cómputo, redes y almacenamiento. Este enfoque permite que los recursos se coordinen como si el centro de datos fuera un ordenador único, en lugar de una suma de nodos independientes conectados entre sí.

Esta arquitectura converge con una tendencia clara en la industria: el paso de servidores discretos a plataformas a escala de rack y despliegues tipo POD, donde cada bastidor está optimizado para una tarea concreta pero todos se coordinan para sostener cargas de trabajo de IA cada vez más complejas.

Rack NVL72: 72 GPU Rubin y 36 CPU Vera para entrenar e inferir

El corazón de la plataforma es el rack NVIDIA Vera Rubin NVL72, que combina 72 GPU Rubin y 36 CPU Vera interconectadas mediante NVLink 6. A ello se suman las SuperNIC ConnectX-9 y las DPU BlueField-4, que se encargan de la aceleración de red, el almacenamiento y la seguridad dentro del propio bastidor.

Este diseño permite entrenar modelos grandes tipo mixture-of-experts usando aproximadamente una cuarta parte de las GPU que necesitaba la generación previa basada en la plataforma Blackwell. Desde el punto de vista económico, NVIDIA afirma que el NVL72 alcanza hasta 10 veces más rendimiento de inferencia por vatio y reduce el coste por token a una décima parte frente a esa arquitectura anterior.

Para empresas que consumen grandes volúmenes de cómputo a través de la nube, estas cifras apuntan a facturas de inferencia sensiblemente más bajas a medida que los proveedores adopten Vera Rubin en sus centros de datos. A medio plazo, esto podría abaratar el despliegue de aplicaciones de IA intensivas en tokens, desde asistentes conversacionales hasta sistemas de análisis documental masivo.

El NVL72 está diseñado para escala de hipercentro de datos. Se integra con NVIDIA Quantum‑X800 InfiniBand y Spectrum‑X Ethernet para formar grandes clústeres de GPU con altos niveles de utilización, reduciendo tanto el tiempo de entrenamiento como el coste total de propiedad. El resultado buscado es maximizar las horas de cómputo útiles en escenarios donde los modelos se entrenan y ajustan de manera continua.

CPU NVIDIA Vera: procesador para la era de la IA agéntica

En la arquitectura Vera Rubin, la CPU NVIDIA Vera deja de ser un componente secundario para convertirse en pieza clave en el aprendizaje por refuerzo y la IA agéntica. NVIDIA la presenta como el primer procesador diseñado específicamente para este tipo de cargas, con un rendimiento que, según sus propias métricas, ofrece resultados un 50% más rápidos y el doble de eficiencia que las CPU tradicionales a escala de rack.

El chip integra 88 núcleos personalizados capaces de ejecutar dos tareas por núcleo mediante Spatial Multithreading, lo que busca garantizar un rendimiento predecible y estable en entornos multitenant. Esta capacidad resulta especialmente relevante para fábricas de IA que ejecutan miles de agentes y herramientas autónomas a la vez, donde la consistencia del tiempo de respuesta es tan importante como la potencia bruta.

El rack de CPU Vera, construido sobre la arquitectura modular NVIDIA MGX y refrigerado por líquido, agrupa 256 procesadores Vera en un único bastidor. Según los datos facilitados por la compañía, esta configuración puede sostener más de 22.500 entornos de CPU simultáneos, lo que la convierte en una infraestructura pensada para validar y probar en paralelo los resultados generados por las GPU en escenarios de aprendizaje por refuerzo.

La conexión entre estas CPU y las GPU Rubin se realiza a través de NVLink‑C2C, con un ancho de banda coherente de alrededor de 1,8 TB/s. Este enlace de alta velocidad está diseñado para que los datos fluyan sin cuellos de botella entre las etapas de razonamiento, planificación y ejecución de los agentes de IA.

Groq 3 LPX: inferencia determinista y de baja latencia

Una de las novedades más llamativas de la plataforma es la integración de la LPU NVIDIA Groq 3 en forma de rack Groq 3 LPX, orientado específicamente a tareas de inferencia con baja latencia y contextos muy amplios. En lugar de actuar como un sustituto de la GPU, este componente se plantea como un complemento para acelerar la generación de tokens en modelos de gran tamaño.

El rack LPX incorpora 256 procesadores LPU Groq 3, con 128 GB de SRAM integrada y un ancho de banda de memoria escalable en el orden de los 640 TB/s. Este diseño pretende que una flota de LPU funcione como un único procesador lógico, capaz de ofrecer una inferencia rápida y determinista incluso en modelos con billones de parámetros y ventanas de contexto de millones de tokens.

Al desplegar el rack LPX junto con el NVL72, las GPU Rubin y las LPU Groq 3 cooperan para calcular cada capa del modelo para cada token de salida. NVIDIA sostiene que este enfoque logra hasta 35 veces más rendimiento de inferencia por megavatio frente a arquitecturas de propósito general, abriendo la puerta a servicios de IA de muy alta calidad con una huella energética más contenida.

Desde la óptica de negocio, este incremento de eficiencia se traduce en la posibilidad de ofrecer servicios de inferencia de gama alta —por ejemplo, modelos de frontera con grandes contextos— con márgenes más atractivos, algo especialmente relevante para proveedores europeos de soluciones de IA que busquen diferenciarse sin disparar sus costes de infraestructura.

BlueField-4 STX y DOCA Memos: almacenamiento pensado para el contexto

La otra pata de la plataforma es el rack de almacenamiento NVIDIA BlueField‑4 STX, planteado como una infraestructura de almacenamiento nativa de IA que actúa como extensión de la memoria de la GPU a través del POD. Se apoya en el chip BlueField‑4, que combina la CPU Vera con la SuperNIC ConnectX‑9 para proporcionar una capa compartida de alto ancho de banda.

Este sistema está optimizado para gestionar la caché clave‑valor generada por los grandes modelos de lenguaje y los flujos de trabajo agénticos. En lugar de tratar esta información como simple almacenamiento generalista, STX le dedica recursos específicos para que el acceso al contexto sea más rápido y eficiente.

Sobre esta base se asienta NVIDIA DOCA Memos, un nuevo marco de software que organiza el almacenamiento de la KV cache de forma dedicada. La compañía asegura que esta aproximación puede multiplicar por cinco el rendimiento de la inferencia respecto a arquitecturas de almacenamiento tradicionales, al tiempo que mejora de forma notable la eficiencia energética del sistema.

Para aplicaciones que requieren interacciones de múltiples turnos con agentes de IA, esta combinación de hardware y software busca reducir los tiempos de espera y aumentar la escalabilidad. En la práctica, se trata de mantener una memoria de contexto amplia sin penalizar el rendimiento ni aumentar en exceso el consumo eléctrico del centro de datos.

Red Spectrum-6 SPX y DSX: red y energía para factorías de IA

El rack Ethernet NVIDIA Spectrum‑6 SPX completa la arquitectura como elemento de red principal, orientado a acelerar el tráfico este‑oeste entre racks dentro de la fábrica de IA. Puede configurarse con switches Spectrum‑X Ethernet o con sistemas Quantum‑X800 InfiniBand, en ambos casos con el objetivo de ofrecer conectividad de rack a rack con baja latencia y alto rendimiento.

La fotónica integrada en Spectrum‑X promete una eficiencia energética óptica varias veces superior a la de los transceptores enchufables clásicos, además de una mayor resistencia operativa. En un escenario donde los datos se mueven de forma constante entre GPU, CPU, LPU y sistemas de almacenamiento, esta capa de red es crítica para evitar que el cuello de botella se traslade a la conectividad.

En paralelo, NVIDIA introduce la plataforma DSX para Vera Rubin, desarrollada junto a más de 200 socios de infraestructura de centros de datos. Dentro de este conjunto, DSX Max‑Q permite un aprovisionamiento dinámico de energía en la fábrica de IA, con la promesa de desplegar hasta un 30% más de infraestructura en un centro de datos con límite de potencia fijo.

Por su parte, DSX Flex está pensado para convertir estas factorías de IA en activos flexibles para la red eléctrica, capaces de aprovechar energía que quedaría varada. La compañía habla de hasta 100 gigavatios potencialmente desbloqueados, una cifra que, más allá del titular, ilustra la intención de integrar la IA de alto rendimiento con los objetivos de eficiencia energética y sostenibilidad, un aspecto sensible en la Unión Europea.

Rendimiento, eficiencia y foco en IA agéntica

En su presentación, NVIDIA enmarca Vera Rubin como respuesta directa a la IA agéntica, es decir, a sistemas capaces de planificar, ejecutar herramientas, interactuar con datos y validar resultados de forma autónoma. La compañía identifica cuatro grandes ejes de escalado —preentrenamiento, post‑entrenamiento, escalado en tiempo de prueba e infraestructura para agentes— y sitúa su plataforma como soporte para todos ellos.

En ese contexto, el protagonismo del rack de CPU Vera tiene sentido: las cargas de trabajo de aprendizaje por refuerzo y validación agéntica dependen de miles de entornos basados en CPU que prueban constantemente las decisiones generadas por los modelos ejecutados en GPU. Al ofrecer un rendimiento de hilo único elevado y una eficiencia notable, estas CPU buscan acortar los ciclos de prueba y mejorar la estabilidad de los agentes en producción.

La combinación de NVL72, rack de CPU Vera, Groq 3 LPX y BlueField‑4 STX construye, en la práctica, una plataforma pensada para operar modelos de frontera con grandes ventanas de contexto, tanto en entrenamiento como en inferencia. Para organizaciones que estén valorando automatizar procesos complejos con agentes —desde atención al cliente hasta operaciones financieras o industriales— la propuesta de NVIDIA pretende proporcionar una base de hardware preparada para esa nueva generación de aplicaciones.

Además, la compañía subraya que estos avances se traducen en una mejora directa de la métrica de tokens por vatio, clave para cuadrar la ecuación entre potencia de cálculo y costes energéticos. Esa métrica resulta especialmente relevante para centros de datos europeos, que operan bajo regulaciones de eficiencia y sostenibilidad cada vez más estrictas.

Ecosistema, disponibilidad y adopción en la nube

El despliegue de Vera Rubin se hará de forma progresiva a partir de la segunda mitad del año, con un papel central de los grandes proveedores cloud y los fabricantes de sistemas. NVIDIA ha confirmado que Amazon Web Services, Google Cloud, Microsoft Azure y Oracle Cloud Infrastructure ofrecerán productos basados en esta plataforma, junto con socios especializados como CoreWeave, Crusoe, Lambda, Nebius, Nscale y Together AI.

En el terreno del hardware, la compañía espera que fabricantes globales como Cisco, Dell Technologies, HPE, Lenovo, Supermicro, ASUS, Foxconn, GIGABYTE, Quanta Cloud Technology o Wiwynn comercialicen servidores y soluciones basadas en Vera Rubin. Esta lista incluye a varios actores con fuerte presencia en España y Europa, lo que facilita que empresas y organismos públicos puedan acceder a la tecnología en proyectos on‑premise o de nube híbrida.

Además, los grandes laboratorios de IA y desarrolladores de modelos de frontera —Anthropic, Meta, Mistral AI, OpenAI y otros actores relevantes— ya han mostrado interés en utilizar la plataforma para entrenar modelos más grandes y servir sistemas multimodales de contexto largo con menor latencia y coste que en generaciones de GPU previas.

Para las compañías europeas que se apoyan en APIs de estos proveedores, el impacto puede no ser inmediato, pero a medida que la infraestructura subyacente migre hacia Vera Rubin es razonable esperar mejoras en tiempo de respuesta, calidad de modelo y costes por uso. A efectos prácticos, empresas que hoy consumen servicios de IA desde España podrían beneficiarse de esta evolución sin necesidad de gestionar directamente el nuevo hardware.

La plataforma NVIDIA Vera Rubin se presenta como una apuesta integral por las fábricas de IA, unificando cómputo, red, almacenamiento y gestión energética en una arquitectura de siete chips y cinco racks que opera como una sola supercomputadora. Con el foco puesto en la IA agéntica, la eficiencia energética y la reducción del coste por token, y con el respaldo de los principales proveedores cloud y fabricantes de sistemas, esta propuesta se perfila como una de las bases tecnológicas sobre las que se construirán muchos de los servicios de inteligencia artificial que llegarán a empresas y administraciones europeas en los próximos años.