- El análisis detallado de equipos y tráfico de red mejora visibilidad, rendimiento y seguridad en infraestructuras modernas.

- Herramientas como NetFlow Analyzer, WhatsUp Gold, Site24x7, Datadog y Splunk permiten monitorización avanzada y respuesta automatizada.

- Inventario de red, análisis WiFi (AirMagnet, Ekahau) y sondas de seguridad completan una estrategia de gestión proactiva.

- El uso combinado de analizadores software, hardware y técnicas de descubrimiento convierte la red en un activo estratégico para el negocio.

Cuando una empresa empieza a crecer de verdad, la red deja de ser “ese cableado que más o menos funciona” y pasa a convertirse en una pieza crítica del negocio. En ese punto, ya no basta con saber si hay conexión o no: hay que entender qué dispositivos hay conectados, quién se está comiendo el ancho de banda, qué aplicaciones generan más tráfico y si hay comportamientos raros que puedan apuntar a una brecha de seguridad o a un cuello de botella a la vuelta de la esquina.

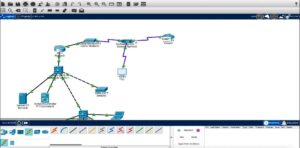

Para todo eso entran en juego las herramientas de análisis detallado de equipos y tráfico de red. Hablamos de soluciones que van mucho más allá del típico “ping” o de ver si un servidor responde: plataformas de monitorización global como WhatsUp Gold, Site24x7, Datadog o Splunk, analizadores de flujo como NetFlow Analyzer, software de inventario, aplicaciones para redes WiFi profesionales como AirMagnet y Ekahau e, incluso, herramientas de análisis de redes sociales como Gephi o NodeXL. Vamos a ver, con calma pero sin rodeos, cómo encaja todo esto en el día a día de una red moderna y qué puedes sacar en claro si decides tomarte el análisis de red en serio.

Qué es realmente una herramienta de análisis de redes

Una herramienta de análisis de redes es un software pensado para recoger, visualizar y estudiar en profundidad el tráfico que circula por una red y el comportamiento de los dispositivos conectados. A diferencia de un mero monitor de disponibilidad (que solo te dice si algo está arriba o caído), estas soluciones se meten hasta la cocina: protocolos utilizados, aplicaciones implicadas, conversaciones entre IPs, consumo por interfaz, eventos de seguridad y mucho más.

En una red corporativa actual conviven sin descanso aplicaciones en la nube, copias de seguridad, videollamadas, VoIP, acceso remoto, IoT, redes WiFi densas… Sin visibilidad real es casi imposible que un administrador entienda por qué la red va lenta, qué servicio se está atragantando o si ese pico de tráfico a media noche es una copia de seguridad… o un ataque en curso.

El análisis en tiempo real aporta precisamente esa visibilidad. Para ello, las herramientas especializadas recopilan datos como tráfico por origen y destino, desglose por protocolo, tipo de aplicación, rendimiento de los enlaces o estadísticas por dispositivo. Normalmente se apoyan en tecnologías de flujo (NetFlow, sFlow, IPFIX, J-Flow, NetStream, Appflow, etc.) o en captura profunda de paquetes, combinando esa información con detalles de WLAN, VLAN, controladores inalámbricos y otros elementos de la infraestructura.

Gracias a ese cruce de datos se pueden detectar patrones de consumo, anomalías y amenazas, decidir qué tráfico es legítimo y cuál podría ser un abuso o un ataque, y priorizar lo que es realmente crítico para el negocio. Esto permite dejar de “apagar fuegos” y pasar a una gestión proactiva de la red.

Por qué las empresas necesitan análisis avanzado de red

Disponer de una solución seria de análisis de redes es la manera más eficaz de elevar la monitorización a otro nivel. No va solo de ver gráficas bonitas; se trata de detectar a tiempo cualquier problema que pueda afectar al rendimiento, la disponibilidad o la seguridad de la infraestructura antes de que toque al usuario final.

Muchas anomalías de tráfico no son ataques, pero un pico repentino, un cuello de botella recurrente o un comportamiento raro suelen ser la pista previa a caídas de servicio, latencias insoportables o brechas de seguridad. Las herramientas de análisis ofrecen una visión global de todos los componentes: routers, switches, firewalls, controladores WLAN, interfaces, aplicaciones, IP de origen y destino, e incluso geolocalización de los focos de problema.

Podemos considerar que una herramienta de análisis de redes es realmente útil cuando ayuda a diagnosticar y resolver incidencias rápido, prevenir saturaciones de ancho de banda, identificar amenazas internas y externas, localizar las conversaciones que más recursos consumen y vigilar la disponibilidad de los servicios clave.

En organizaciones grandes o muy distribuidas este valor se multiplica. Centralizar en una sola consola varias sedes, redes cableadas y WiFi, entornos virtuales y nubes públicas, con sistemas de alarmas configurables y paneles adaptados para equipos de operaciones, seguridad o negocio, marca la diferencia entre reaccionar con calma o entrar en modo pánico cada vez que algo se tuerce.

Análisis basado en flujos: el enfoque de NetFlow Analyzer

Un ejemplo clásico de solución orientada al tráfico es NetFlow Analyzer, una plataforma basada en flujos de red que responde a las tres preguntas que todo administrador se hace a diario: quién, cuándo y qué dentro de la red. Trabaja con la información que exportan los dispositivos (NetFlow, sFlow, IPFIX, J-Flow, FNF, NetStream, Appflow…) y monitoriza interfaces e IPs casi en tiempo real.

NetFlow Analyzer descompone cada flujo que recorre la red y identifica aplicaciones predominantes, conversaciones más pesadas y usuarios que abusan del ancho de banda, detectando además cambios bruscos en el uso de un enlace. Todo se presenta mediante gráficos estándar y personalizados, informes históricos y un panel resumen que permite tener una imagen global de la infraestructura de un solo vistazo.

Entre sus funciones destacadas están la monitorización de controladores WLAN (con estadísticas por SSID, punto de acceso y QoS), el seguimiento del tráfico multimedia, VoIP y vídeo para asegurar la calidad del servicio, y el análisis del RTT en enlaces WAN para comprobar que las comunicaciones entre sedes o hacia la nube se mantienen dentro de los parámetros aceptables.

Además, incluye un módulo de análisis de seguridad avanzado (ASAM) orientado a sacar a la luz amenazas complejas como ataques DDoS, botnets o sondas de reconocimiento que podrían pasar desapercibidas detrás del firewall. Mediante informes forenses permite revisar datos históricos, localizar patrones de comportamiento peligrosos a largo plazo y ver su impacto en rendimiento y seguridad.

En el lado de la optimización, NetFlow Analyzer facilita priorizar aplicaciones críticas de negocio aplicando políticas de QoS y verificando su resultado con tecnologías como Cisco CBQoS. De este modo, la red se adapta a las necesidades reales de la organización en lugar de obligar al negocio a encajar en sus limitaciones técnicas.

Para entornos muy distribuidos, la edición Enterprise está pensada para grandes compañías con múltiples ubicaciones, capaz de escalar a decenas de miles de flujos por segundo y gestionar todas las delegaciones desde una sola consola. Su compatibilidad con los principales fabricantes (Cisco, Juniper, HP, Extreme y otros) y con la mayoría de formatos de flujo la convierte en una pieza muy flexible dentro del ecosistema de monitorización.

Inventario de red: conocer a fondo los equipos conectados

El análisis de tráfico es solo una cara de la moneda; la otra es mantener un inventario de red completo y actualizado, es decir, una lista detallada de todos los dispositivos conectados: ordenadores, servidores, switches, routers, impresoras, dispositivos IoT, equipos industriales, etc.

El inventario más básico es una simple relación de equipos, pero cuanto más se profundiza más valor se obtiene: software instalado en cada máquina, parches y hotfix aplicados, números de serie, historial de cambios, relaciones entre dispositivos… Información clave para auditorías de TI, proyectos de migración, renovaciones de hardware o análisis de riesgos.

Un buen software de inventario permite gestionar licencias de software, identificar sobrantes o faltantes, minimizar el riesgo en auditorías de cumplimiento y evitar pagar por licencias que nadie usa. Centralizar esta gestión ayuda también a prevenir fugas de datos y a garantizar que todo el parque informático cumple las políticas de seguridad de la organización.

Ligado al inventario aparece el uso de tecnologías como SNMP, LLDP, ARP y otras técnicas de descubrimiento. SNMP, basado principalmente en UDP, permite que un software gestor descubra dispositivos habilitados (routers, switches, impresoras, firewalls, etc.) consultando sus MIB y obteniendo datos específicos (niveles de tinta, contadores de puertos, tablas NAT…). LLDP, por su parte, facilita que los dispositivos se identifiquen entre vecinos directos a nivel de capa 2, lo que ayuda a mapear automáticamente la topología física.

Mediante pings ICMP, sondas activas que envían pequeños ejecutables para recabar datos, análisis de protocolos de enrutamiento (OSPF, EIGRP) y consultas a la caché ARP, un sistema de administración de red puede reconstruir la topología de capas 2 y 3, saber quién está conectado a quién y con qué parámetros, y mantener ese inventario vivo sin intervención manual constante.

Analizadores de red: software, hardware y funcionamiento

Para profundizar en el tráfico hay dos grandes familias de herramientas: analizadores software y analizadores hardware. Cada uno tiene su papel dependiendo del entorno y de los protocolos implicados.

Los analizadores software suelen ser genéricos, se centran en protocolos ampliamente extendidos y documentados, y en muchos casos son gratuitos o de código abierto. Son los más habituales en redes corporativas tradicionales, donde predominan estándares como TCP/IP, HTTP, DNS, etc.

En cambio, los analizadores hardware se orientan a entornos muy específicos, como redes industriales con protocolos propietarios o poco documentados. Suelen ser de pago (a veces con precios altos) porque incorporan hardware especializado y módulos capaces de interpretar tramas complejas o muy particulares.

Dentro de los analizadores software, probablemente Wireshark sea el más conocido. Permite capturar y analizar paquetes al detalle, ver cómo se construyen las tramas TCP y UDP, inspeccionar protocolos de nivel superior y estudiar conversaciones paso a paso. Alternativas como TCPDump o WinDump ofrecen la misma potencia desde línea de comandos, ideales para técnicos avanzados o para servidores sin entorno gráfico.

En el mundo hardware encontramos soluciones comerciales como Achilles, Netdecoder, Line Eye y otros, que añaden funciones avanzadas como fuzzer de protocolos (para probar implementaciones), osciloscopios para comprobar frecuencias o analizadores de señal para medir voltajes. A cambio, muchas veces no permiten revisar capturas guardadas, algo que sí es sencillo con herramientas software.

Modos de captura de tráfico: hub, puerto espejo y TAP

Para que un analizador software pueda trabajar, hay que redirigir el tráfico que queremos inspeccionar hacia el equipo que corre la herramienta. Existen dos métodos clásicos: utilizar un hub o configurar un puerto espejo en un switch.

El método del hub o concentrador consiste en introducir un dispositivo que repita todo el tráfico que pasa por él hacia todos sus puertos. Conectando el analizador a uno de esos puertos se puede observar lo que circula por el segmento, aunque la capacidad es limitada y hoy en día casi todo el mundo usa switches en lugar de hubs por rendimiento y seguridad.

Más habitual es recurrir al puerto espejo (SPAN) en un switch gestionable. Se configura un puerto para que reciba copia de todo el tráfico que pasa por uno o varios puertos o VLAN, y es ahí donde se conecta el analizador. El inconveniente es que, si el volumen de tráfico es muy alto, el puerto espejo puede saturarse y se perderán paquetes, obteniendo una visión parcial.

En el caso de los analizadores hardware se utilizan dispositivos tipo Network TAP, diseñados específicamente para capturar tráfico de forma transparente y redirigirlo hacia la herramienta de análisis, normalmente a través de USB u otra interfaz dedicada. Estos TAP pueden trabajar con medios muy variados (Ethernet, RS-232, RS-485, fibra, etc.) y están pensados para introducirse en la línea sin alterar el comportamiento del sistema.

En redes industriales, donde se manejan múltiples protocolos y sistemas críticos, estos dispositivos ayudan no solo a monitorizar el tráfico, sino también a validar la implementación de los protocolos, generando e inyectando tramas (a menudo inválidas) para comprobar el comportamiento de los equipos. Eso sí, estas pruebas deben hacerse en entornos de test o fuera de producción, porque casi seguro llevarán al sistema a estados inestables.

Análisis de redes y seguridad: del perro guardián al forense

El análisis de red tiene un papel clave en la seguridad porque actúa como un “perro guardián” permanente: las herramientas monitorizan 24/7/365, vigilan el tráfico, detectan intrusiones, supervisan el uso de ancho de banda y recursos, y generan alertas en tiempo real cuando algo se sale de lo normal.

En caso de incidente, toda esa información se convierte en un recurso de análisis forense. Se puede rastrear el origen de una intrusión, seguir el movimiento lateral de un atacante dentro de la red, identificar qué dispositivos se han visto comprometidos y qué datos podrían haberse filtrado. Esto permite acotar el problema y poner medidas correctoras sin ir completamente a ciegas.

Herramientas como TCPDump, WinDump, Nmap, Wireshark, Aircrack-ng o suites completas como Kali Linux resultan muy útiles para hacer pruebas de intrusión (pentesting), identificar puntos débiles y reforzar la infraestructura antes de que lo haga un atacante. Muchas de estas utilidades son gratuitas, multiplataforma y se incluyen en distribuciones especializadas bien conocidas por la comunidad de seguridad.

Por ejemplo, Nmap permite escanear rangos de IP, descubrir qué máquinas están activas, qué puertos tienen abiertos, qué servicios ejecutan e incluso estimar el sistema operativo. Esta información sirve para evaluar la superficie de ataque expuesta y priorizar parches o cambios de configuración, sabiendo que los “malos” usan exactamente las mismas herramientas para preparar sus ataques.

Redes sociales y análisis de redes: Gephi y NodeXL

Cuando hablamos de análisis de redes no todo son cables, routers y switches. Existe un campo muy amplio dedicado al análisis de redes sociales y relaciones entre personas, organizaciones o países

En plataformas como Twitter, YouTube o comunidades online, el análisis de redes consiste en representar y estudiar patrones de conexión entre usuarios, hashtags, contenidos o interacciones. Se manejan métricas como la centralidad (quién es más influyente), la densidad (cuán conectada está la red), la intermediación (nodos puente) o la cercanía entre actores.

Aquí entran herramientas como Gephi, un software de exploración y visualización interactiva de redes y grafos complejos, que permite trabajar con decenas de miles de nodos y hasta un millón de aristas sin necesidad de programar. Admite formatos de entrada típicos en análisis de redes (GML, GDF, Pajek NET, GEXF, GraphML…) y ofrece algoritmos de disposición y estadísticas para explorar la estructura de la red, además de exportar gráficos e informes.

Por otro lado, NodeXL es un complemento para Microsoft Excel orientado a representar grafos a partir de listas de conexiones. Integra conectores para APIs de redes sociales como Twitter, Flickr o YouTube, y permite automatizar tareas, crear redes semánticas, analizar listas de usuarios o estudiar recomendaciones de vídeos, todo desde un entorno tan familiar como Excel.

Tanto Gephi como NodeXL cuentan con materiales de ayuda, comunidades activas y presencia en redes sociales que facilitan su aprendizaje y el intercambio de casos de uso. Son un buen ejemplo de cómo el análisis de redes trasciende la infraestructura física y se aplica también al estudio de la información y las relaciones en el mundo digital.

Mediciones avanzadas en redes WiFi: planificación, survey y espectro

Si nos centramos en redes inalámbricas profesionales, entran en juego herramientas como AirMagnet y Ekahau, dos de las soluciones más populares para el diseño, análisis y auditoría de grandes despliegues WiFi. No son para la WiFi de casa, pero en edificios grandes, entornos de alta densidad o con requisitos estrictos de seguridad son prácticamente imprescindibles.

Una de sus funciones estrella es el planificador WiFi. Antes de colocar físicamente los puntos de acceso, se parte de los planos del edificio e información sobre materiales (paredes, techos, estanterías metálicas, etc.) para simular cómo se propagará la señal. El software genera mapas de calor en 2D o 3D que muestran cobertura, zonas de sombra y posibles fugas de señal hacia el exterior, algo muy relevante en seguridad.

Durante esta fase se definen las características de cada punto de acceso: tipo de antena, ganancia, potencia de transmisión, estándar WiFi (802.11g/n/ac/ax, por ejemplo) y configuración individual de canales y potencias según las necesidades locales. El planificador ayuda a diseñar una distribución de canales óptima para minimizar interferencias, algo crítico en entornos densos donde los AP se pisan fácilmente.

Una vez desplegada la red (o si ya existía), se pasa a la fase de survey o estudio de cobertura. Técnicos recorren físicamente el espacio, dispositivo en mano, para mapear niveles de señal, interferencias, número de redes ajenas detectadas y otros parámetros de calidad. Con esa información se comprueba si la red cumple los requisitos, se ajustan potencias, se recolocan APs o se refuerzan zonas conflictivas.

Otro módulo clave de estas herramientas es el analizador de espectro. Las bandas de 2,4 GHz y 5 GHz se comparten con multitud de dispositivos (microondas, cámaras inalámbricas, sensores, sistemas de detección de movimiento…), que pueden generar interferencias y arruinar la experiencia de usuario. Un buen análisis de espectro ayuda a encontrar rápidamente estas fuentes externas y plantear medidas como cambiar canales, reubicar equipos o blindar ciertas áreas.

Seguridad WiFi, BYOD y localización de dispositivos

En redes corporativas, la seguridad WiFi no se limita a activar WPA2 o WPA3; la autenticación basada en hardware también aporta una capa adicional. Plataformas avanzadas como AirMagnet o Ekahau ayudan a detectar puntos de acceso no autorizados (rogue APs), que un atacante puede desplegar para engañar a usuarios y robar credenciales. Al monitorizar de forma continua el entorno radioeléctrico, se identifican estos dispositivos espía y se actúa antes de que provoquen un incidente serio.

La tendencia BYOD (Bring Your Own Device) añade otra capa de complejidad: empleados conectan móviles, tablets u ordenadores personales a la red corporativa, a menudo con software desactualizado o sin cumplir las políticas de seguridad. Las herramientas de análisis permiten detectar estos dispositivos, segmentarlos adecuadamente, limitar su acceso a ciertos recursos y vigilar su comportamiento dentro de la red inalámbrica.

Otra funcionalidad muy interesante es la localización de clientes WiFi. Mediante triangulación o dispositivos específicos de posicionamiento, es posible estimar dónde se encuentran físicamente los equipos conectados o activos con adaptadores WiFi o tags (carros de almacén, cajas, vehículos, equipos médicos, etc.). Esto ayuda a controlar movimientos dentro de las instalaciones, hacer seguimiento de activos valiosos o investigar pérdidas y robos.

Combinando planificación, survey, análisis de espectro y funciones de seguridad, estas plataformas se convierten en aliadas fundamentales para redes WiFi grandes o críticas, donde ancho de banda, disponibilidad y confidencialidad de la información son factores que no se pueden dejar al azar.

Ciclo completo de análisis de redes informáticas

Si subimos un nivel, el análisis de redes informáticas se puede ver como un proceso estructurado en tres grandes etapas: recogida de datos, análisis e interpretación, y aplicación de alertas y medidas correctoras. Hoy en día, gran parte de este ciclo está muy automatizado para evitar cargas manuales innecesarias.

En la primera fase se recopilan datos de servidores, dispositivos de red y tráfico, usando flujos (NetFlow, sFlow, IPFIX), telemetría o inspección profunda de paquetes (DPI). La DPI examina el contenido de los paquetes para evaluar calidad de servicio, perfilar endpoints o detectar intrusiones, mientras que la telemetría ofrece métricas continuas del estado de salud de la red y sus dispositivos.

Una vez recolectados, los datos pasan a la capa de análisis e interpretación. Aquí las herramientas clasifican, correlacionan y contextualizan la información respecto a valores de referencia: latencias normales, anchos de banda típicos, tipos de tráfico esperados, patrones horarios habituales, etc. Cuando algo se desvía demasiado de lo que se considera “normal”, se disparan alertas y se pueden proponer o ejecutar acciones.

Esta interpretación no se limita a lo técnico: una lectura inteligente de los KPI de red puede aportar insights de negocio. Por ejemplo, mostrar horas punta en un e-commerce, detectar cuellos de botella en un recorrido de compra, medir el impacto real de una campaña de marketing en el tráfico o descubrir problemas de rendimiento que afectan a una cadena de suministro digital.

Finalmente, llega la fase de alertas y respuesta. Los sistemas de monitorización permiten configurar notificaciones en tiempo real ante fallos, degradaciones, intrusiones o cualquiera anomalía relevante. Cada vez es más común que estas herramientas apliquen respuestas automáticas: bloquear IP sospechosas, aislar un dispositivo comprometido, redirigir tráfico por rutas alternativas, reiniciar servicios o ajustar recursos dinámicamente.

Ventajas clave del análisis de redes para la organización

Implementar un análisis de redes sólido ofrece beneficios muy tangibles. En primer lugar, mejora la protección frente a ciberataques, al identificar patrones maliciosos (escaneos de puertos, fuerza bruta, movimientos laterales, exfiltración de datos) y permitir respuestas tempranas que corten el problema de raíz.

En segundo lugar, facilita la detección temprana de fallos técnicos: enlaces saturados, dispositivos que empiezan a degradarse, servicios con tiempos de respuesta crecientes, etc. Al disponer de monitorización en tiempo real se pueden evitar paradas importantes, reducir el tiempo de inactividad y mejorar la experiencia del usuario interno y externo.

Otro punto clave es la aplicación ágil y automatizada de parches, entendidos no solo como actualizaciones de software, sino como cambios de configuración, ajustes de recursos o medidas de contención. Cuanto más automatizado esté este proceso, más rápida y coherente será la respuesta de la red ante incidentes, reduciendo la dependencia de la intervención manual en momentos críticos.

Por último, el análisis de redes se ha convertido en un elemento central para la toma de decisiones estratégicas basadas en datos. Al procesar grandes volúmenes de información de forma continua, las empresas pueden diseñar campañas de marketing ajustadas al comportamiento real de los usuarios, optimizar recorridos de compra, racionalizar inversiones en infraestructura y, en general, alinear mejor la tecnología con los objetivos del negocio.

Principales plataformas de monitorización y análisis de red

En el mercado existe una oferta amplísima de productos para monitorización y análisis de redes, pensados para distintos tamaños de empresa y niveles de complejidad. Algunas de las soluciones más destacadas para analizar en detalle equipos y tráfico de red son WhatsUp Gold, Site24x7, Datadog y Splunk Enterprise, entre otras.

WhatsUp Gold está orientado sobre todo a pymes y empresas medianas, aunque escala razonablemente bien. Su punto fuerte es ofrecer una visión de 360° de toda la infraestructura, con mapas interactivos de red, monitorización de dispositivos cableados, inalámbricos y virtuales, y un sistema de alertas en tiempo real. Además, permite generar informes y paneles personalizados, así como analizar el tráfico para descubrir qué usuarios, aplicaciones o protocolos acaparan el ancho de banda.

ManageEngine Site24x7 se vende como una solución de monitorización “todo en uno”: sitios web, transacciones, servidores, aplicaciones, servicios en la nube y, por supuesto, la red. Desde una única consola es posible vigilar el rendimiento de páginas y APIs, el estado del tráfico de red y la configuración de los dispositivos, con informes detallados, herramientas de cartografía, alarmas flexibles y acciones correctivas automatizadas. Es una opción versátil tanto para entornos pequeños como para arquitecturas corporativas complejas.

Datadog está muy enfocado a organizaciones con grandes volúmenes de datos y arquitecturas distribuidas (microservicios, contenedores, nubes híbridas…). Facilita correlacionar métricas de red, infraestructura, logs y experiencia de usuario para detectar anomalías de forma automática, recibir alertas inteligentes, localizar el origen de tiempos de carga excesivos, analizar sesiones de usuario y priorizar amenazas de seguridad, con un fuerte apoyo en analítica avanzada e IA.

Por su parte, Splunk Enterprise es una plataforma de análisis de datos de propósito amplio, capaz de procesar flujos en tiempo real de todo tipo de fuentes dentro de la infraestructura de TI. Permite crear cuadros de mando muy personalizables, configurar alertas, aplicar modelos de machine learning y conectar con múltiples integraciones (Azure, AWS, Google Cloud, etc.). Para muchas empresas se convierte en el motor central de datos de red y sistemas sobre el que se construyen soluciones de seguridad, monitorización de infraestructura y analítica de negocio.

Combinando estas soluciones generales con herramientas específicas como NetFlow Analyzer, AirMagnet, Ekahau, Gephi, NodeXL o software de inventario y descubrimiento, una organización puede cubrir desde el detalle más fino de paquetes y flujos hasta la visión global de negocio y seguridad, incluyendo el diseño minucioso de la red WiFi o el estudio de relaciones en redes sociales.

Al final, invertir en análisis detallado de equipos para redes significa pasar de una gestión reactiva, siempre apagando fuegos, a un control continuo con visibilidad profunda del tráfico, los dispositivos y la experiencia de usuarios. Esa visibilidad reduce riesgos, mejora la estabilidad, aprovecha mejor el ancho de banda disponible y convierte a la infraestructura de comunicaciones en un verdadero habilitador del negocio en lugar de una fuente constante de sorpresas desagradables.