- TurboQuant comprime la caché KV de los modelos de IA y reduce su memoria hasta seis veces sin reentrenar el modelo.

- La técnica combina PolarQuant y QJL para llevar la cuantización incluso a 3 bits con una pérdida mínima de precisión.

- En pruebas con Gemma y Mistral, Google reporta hasta 8x más velocidad en el cálculo de atención en GPU Nvidia H100.

- El avance apunta a abaratar la inferencia, facilitar contextos largos y escalar la búsqueda vectorial en entornos como Europa.

Google ha dado a conocer TurboQuant, una nueva familia de algoritmos de compresión de memoria aplicada a modelos de inteligencia artificial que busca atacar uno de los cuellos de botella más incómodos de la IA moderna: la enorme cantidad de memoria necesaria para que los modelos mantengan el contexto mientras generan respuestas. La compañía plantea un enfoque que recorta de forma muy agresiva el uso de memoria en inferencia sin necesidad de reentrenar los modelos y con un impacto mínimo en su precisión.

Según los datos publicados por Google Research, TurboQuant es capaz de reducir al menos seis veces el tamaño de la caché clave-valor (KV cache), esa memoria temporal donde el modelo guarda la información que ya ha procesado para no recalcularlo todo palabra a palabra. Además, en determinados escenarios, la compañía asegura que el cálculo de atención se acelera hasta ocho veces frente a claves no cuantizadas de 32 bits en GPU Nvidia H100. Traducido a un lenguaje más cotidiano: menos memoria ocupada, menor coste por consulta y más margen para ejecutar modelos grandes en hardware más modesto, algo especialmente relevante para centros de datos europeos que buscan contener consumo energético y presupuesto.

TurboQuant ataca el problema de la caché KV en modelos de lenguaje

Cuando un modelo de lenguaje responde a una pregunta o analiza un documento largo, no vuelve a procesar desde cero todo el texto cada vez. Va almacenando internamente una serie de claves y valores que representan lo que ya ha entendido, lo que le permite seguir el hilo de la conversación y trabajar con contextos cada vez más extensos. Ese “apuntes” digital es la llamada caché KV, y es precisamente ahí donde se dispara el uso de memoria a medida que crece el contexto y las interacciones.

El problema para Google, y para cualquier proveedor de IA a gran escala en Europa o fuera de ella, es que esta memoria intermedia puede llegar a ocupar una parte enorme de la GPU, elevando tanto el coste de la infraestructura como las barreras de entrada para nuevos actores. La propuesta de TurboQuant se centra en comprimir esa caché KV de forma muy agresiva, llevando la cuantización a tan solo 3 bits por valor sin introducir pérdidas apreciables de calidad en las respuestas, según los ensayos internos descritos por la compañía.

En sus pruebas, Google aplicó TurboQuant a modelos abiertos como Gemma y Mistral y los sometió a benchmarks de contexto largo como LongBench, Needle In A Haystack, ZeroSCROLLS, RULER o L-Eval. Los resultados publicados apuntan a que el método mantiene un rendimiento muy cercano al original al tiempo que reduce la memoria de la caché KV por un factor igual o superior a seis. En tareas como generación de código, resumen de textos o preguntas y respuestas, la compañía afirma que la puntuación se mantuvo estable pese a la fuerte compresión.

Más allá de los gráficos de laboratorio, el mensaje de fondo es bastante directo: si cada conversación, documento o consulta requiere mucha menos memoria, el mismo hardware puede atender más sesiones simultáneas o modelos más grandes. Eso no convierte de golpe un portátil corriente en una supermáquina de IA, pero sí abre la puerta a desplegar sistemas exigentes con menos recursos, algo que preocupa especialmente a proveedores de nube europeos que operan bajo límites regulatorios y energéticos más estrictos.

PolarQuant y QJL: las dos piezas que permiten la compresión extrema

La clave de la propuesta no es solo comprimir más, sino conseguirlo sin introducir una sobrecarga adicional de memoria que anule parte del ahorro. Muchas técnicas de cuantización vectorial ya existentes logran reducir el tamaño de los datos, pero necesitan guardar tablas de constantes o parámetros extra que añaden uno o dos bits por valor. En modelos con millones de claves y contextos muy largos, ese añadido acaba pesando lo suyo.

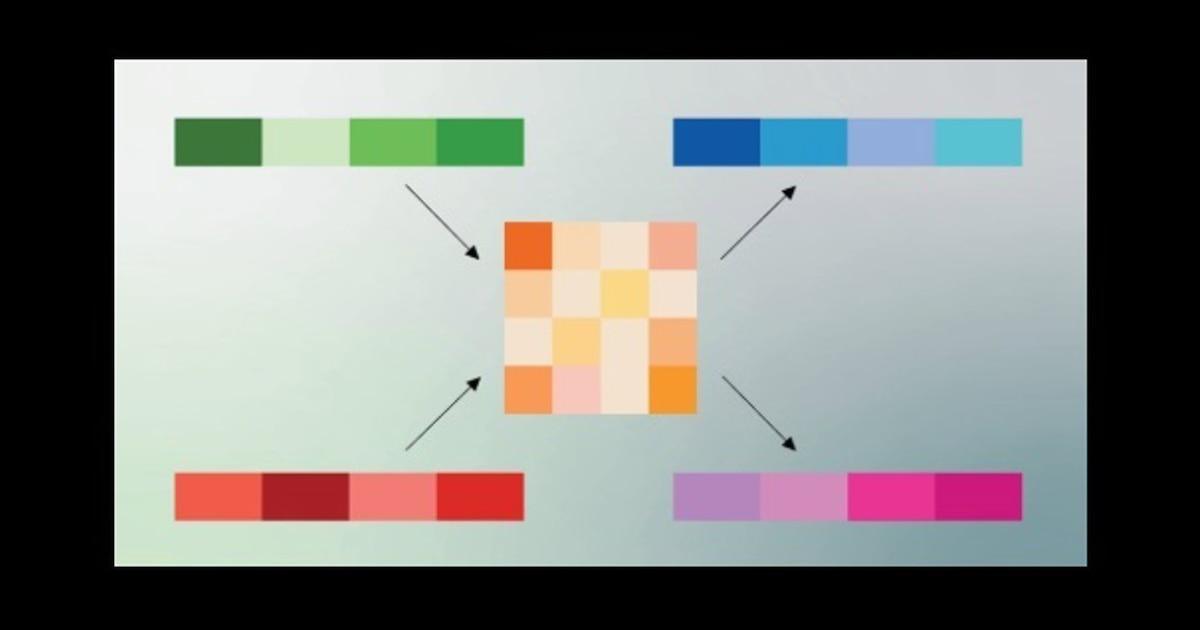

TurboQuant intenta resolver ese punto apoyándose en dos componentes principales: PolarQuant y QJL (Quantized Johnson-Lindenstrauss). PolarQuant se encarga de reorganizar los vectores y trasladarlos a coordenadas polares, separando magnitud y dirección para simplificar la compresión. Este cambio de representación geométrica permite aplicar cuantizadores de alta calidad sobre partes del vector con una cuadrícula más ordenada, reduciendo la distorsión en el producto punto que se utiliza para calcular similitudes y puntuaciones de atención.

Una vez aplicada esa primera compresión, queda un error residual pequeño pero relevante si se aspira a mantener intacta la calidad de la atención. Ahí entra en juego QJL: el sistema reserva únicamente un bit por valor para corregir ese residuo mediante una proyección basada en la transformada de Johnson-Lindenstrauss. Cada componente proyectado se codifica como +1 o -1, y un estimador específico combina esa información ultracompacta con una consulta de alta precisión para ajustar el cálculo final de la atención.

Ese diseño en dos pasos, según el equipo de Google Research, permite que la cuantización se acerque a los límites teóricos de eficiencia sin tener que recurrir a enormes tablas auxiliares o a ajustes meticulosos por conjunto de datos. Los autores subrayan que TurboQuant, PolarQuant y QJL se presentan no solo como trucos de ingeniería, sino como contribuciones algorítmicas con base matemática sólida, algo importante cuando se piensa en desplegar estas técnicas en servicios críticos y de gran escala, como la búsqueda o los asistentes de IA usados a diario por millones de personas en la Unión Europea.

En el ámbito de la búsqueda vectorial, pieza central de los motores de búsqueda semántica y muchos sistemas de recomendación, Google probó TurboQuant frente a métodos conocidos como Product Quantization (PQ) o RabbiQ. De acuerdo con la publicación, la nueva técnica obtuvo mejores tasas de recall en la métrica 1@k, es decir, fue más eficaz a la hora de recuperar el resultado óptimo dentro de sus mejores candidatos sin disparar la memoria necesaria para almacenar los índices.

Resultados en benchmarks y mejora de rendimiento en GPU H100

Además del ahorro de memoria, Google pone el foco en la velocidad. En sus experimentos con aceleradores Nvidia H100, la compañía indica que TurboQuant de 4 bits logró hasta ocho veces más rendimiento en el cálculo de logits de atención frente a claves no cuantizadas de 32 bits. Al reducir el volumen de datos que se mueven y procesan en cada paso, las operaciones se vuelven más ligeras, algo que se nota especialmente en modelos que trabajan con ventanas de contexto muy amplias.

En pruebas tipo Needle In A Haystack, diseñadas para comprobar si un modelo es capaz de encontrar un dato muy concreto escondido en un texto enorme, Google asegura que TurboQuant obtuvo resultados downstream perfectos en los benchmarks reportados mientras reducía la memoria de la caché KV por un factor de al menos seis. En otros conjuntos de evaluación de contexto largo como LongBench, ZeroSCROLLS, RULER o L-Eval, la distorsión en el producto punto y el recall se mantuvieron en niveles calificados como óptimos o casi óptimos.

Uno de los aspectos que más llaman la atención en el entorno técnico es que la cuantización de la caché KV hasta 3 bits no requiere reentrenar el modelo ni aplicar un ajuste fino específico. Se trata de un proceso de compresión que actúa en tiempo de inferencia, lo que lo hace especialmente interesante para proveedores que operan múltiples modelos y versiones en paralelo y no quieren pasar otra vez por fases largas de entrenamiento solo para ganar eficiencia en memoria.

En términos operativos, Google afirma que el tiempo de ejecución con TurboQuant resulta incluso más rápido que el de los modelos originales en los escenarios probados, con una sobrecarga adicional considerada despreciable. Para infraestructuras europeas que ya rozan sus límites de capacidad, ese tipo de mejora abre la puerta a aumentar el número de usuarios atendidos en paralelo o a ampliar el contexto disponible sin multiplicar la factura ni la huella energética.

La empresa también apunta a que, en búsqueda vectorial de alta dimensionalidad, TurboQuant ofrece una distorsión casi óptima de forma independiente de los datos, evitando depender de grandes codebooks entrenados para cada conjunto específico. Esta generalidad simplificaría la adopción en índices a gran escala, algo relevante para operadores de búsqueda y plataformas de contenidos en España y el resto de Europa que manejan catálogos masivos de documentos, productos o medios.

Impacto potencial en costes, centros de datos y despliegues en Europa

Más allá de las cifras concretas de compresión o de velocidad, la lectura interesante para la industria es que una reducción drástica de memoria en inferencia cambia la economía real de servir modelos de IA. Menos memoria por sesión implica acomodar más usuarios concurrentes en la misma infraestructura, reducir la necesidad de adquirir nuevas GPUs y, en el mejor de los casos, contener el crecimiento del consumo eléctrico en centros de datos.

Para proveedores de nube establecidos en Europa, donde las normativas de eficiencia energética y sostenibilidad son cada vez más exigentes, una tecnología capaz de recortar la memoria asociada a la caché KV sin penalizar calidad puede marcar diferencias. Menos presión sobre la RAM y las GPUs y sobre la memoria para servidores significa, entre otras cosas, más margen para ofrecer contextos largos en asistentes conversacionales en castellano u otras lenguas europeas, integrar IA generativa en servicios públicos o empresariales, o escalar motores de búsqueda semántica sin disparar la inversión en hardware.

Este tipo de avances también puede influir indirectamente en el mercado de memoria y almacenamiento. Aunque por ahora no hay señales de un impacto homogéneo, algunos analistas han señalado que mejoras de eficiencia como TurboQuant alimentan el debate sobre cuánta memoria será realmente necesaria para sostener la expansión de la IA a medio plazo. No obstante, el movimiento de las cotizaciones tras el anuncio ha sido dispar y no apunta a conclusiones definitivas: la tecnología todavía se encuentra en una fase temprana y su despliegue comercial real está por ver.

Google enmarca TurboQuant dentro de una estrategia más amplia: pasar de una carrera centrada solo en el tamaño de los modelos a otra donde la eficiencia de ejecución cuenta tanto como la calidad. La compañía sugiere que técnicas de cuantización avanzadas serán piezas clave para mantener servicios de IA a gran escala sin que la infraestructura se convierta en un lastre insostenible, especialmente en regiones donde el precio de la energía y las regulaciones climáticas condicionan la construcción de nuevos centros de datos.

Pese al ruido y a las comparaciones con la ficción, el propio posicionamiento de Google invita a cierto prudencia: TurboQuant se presenta aún como un avance de laboratorio, con resultados prometedores pero limitado recorrido en entornos de producción masivos. Falta comprobar cómo se comporta bajo cargas reales, en modelos propietarios como Gemini o en despliegues con múltiples idiomas y usos intensivos típicos de empresas y administraciones europeas.

Contexto, referencias culturales y próximos pasos

El anuncio no solo ha generado interés técnico, también ha avivado la conversación en redes sociales. Numerosos usuarios han comparado TurboQuant con la ficticia startup Pied Piper de la serie Silicon Valley, cuyo argumento giraba en torno a un algoritmo de compresión casi milagroso. El paralelismo tiene más de guiño cultural que de equivalencia directa, pero ilustra hasta qué punto la idea de “comprimirlo todo sin perder calidad” sigue capturando la imaginación del sector.

En paralelo, algunas voces han descrito el movimiento como una suerte de “momento DeepSeek” para Google, en el sentido de que vuelve a colocar la eficiencia en el centro del debate, esta vez en la fase de inferencia. Aun así, conviene recordar que DeepSeek se hizo popular por su enfoque en el entrenamiento con costes relativos más bajos, mientras que TurboQuant se concentra en la ejecución diaria de modelos ya entrenados. Son frentes complementarios, pero distintos.

De cara a la comunidad académica y al ecosistema de investigación europeo, Google adelanta que PolarQuant será presentado en la conferencia AISTATS 2026 y TurboQuant en ICLR 2026, dos citas de referencia en el campo del aprendizaje automático. La compañía remarca que los algoritmos se han diseñado para ser generalizables y con sobrecarga de memoria prácticamente nula, lo que podría facilitar su adopción por parte de grupos de investigación y empresas que trabajan con modelos abiertos o propios.

La publicación oficial destaca, además, que TurboQuant y sus componentes pueden aplicarse tanto a grandes modelos de lenguaje como a motores de búsqueda vectorial, dos pilares de la infraestructura de IA actual. Esto incluye desde asistentes conversacionales y generadores de texto hasta sistemas de recomendación, buscadores de documentos internos en grandes organizaciones europeas o plataformas de comercio electrónico que necesitan filtrar millones de productos por similitud semántica.

En conjunto, la propuesta sitúa a Google en una línea de trabajo en la que la eficiencia algorítmica se vuelve tan estratégica como el desarrollo de nuevos modelos. Si las cifras de ahorro de memoria y mejora de rendimiento se confirman en despliegues reales, TurboQuant podría convertirse en una pieza discreta pero decisiva para hacer más viable la expansión de la IA avanzada en España y el resto de Europa, aliviando el peso de la caché KV y permitiendo que el mismo hardware llegue un poco más lejos sin necesidad de dar otro salto de escala en recursos.